Nagrinėjant bylą, kurioje oro linijų bendrovė buvo teisiama dėl tariamo asmens sužalojimo, ieškovo advokatai pateikė dokumentą, kuriame buvo kelios bylos, kurios turėjo būti naudojamos kaip teisinis precedentas. Deja, kaip vėliau prisipažino pareiškime, teismas „nustatė, kad šios bylos neegzistuoja“.

BBC teigimu, „tyrimą“ parengė advokatas Stevenas A.Schwartzas, turintis daugiau nei 30 metų advokato darbo patirties. S.A.Schwartzas pareiškime teigė, kad jis anksčiau nesinaudojo „ChatGPT“ teisiniams tyrimams atlikti ir „nežinojo apie galimybę, kad jo turinys gali būti melagingas“.

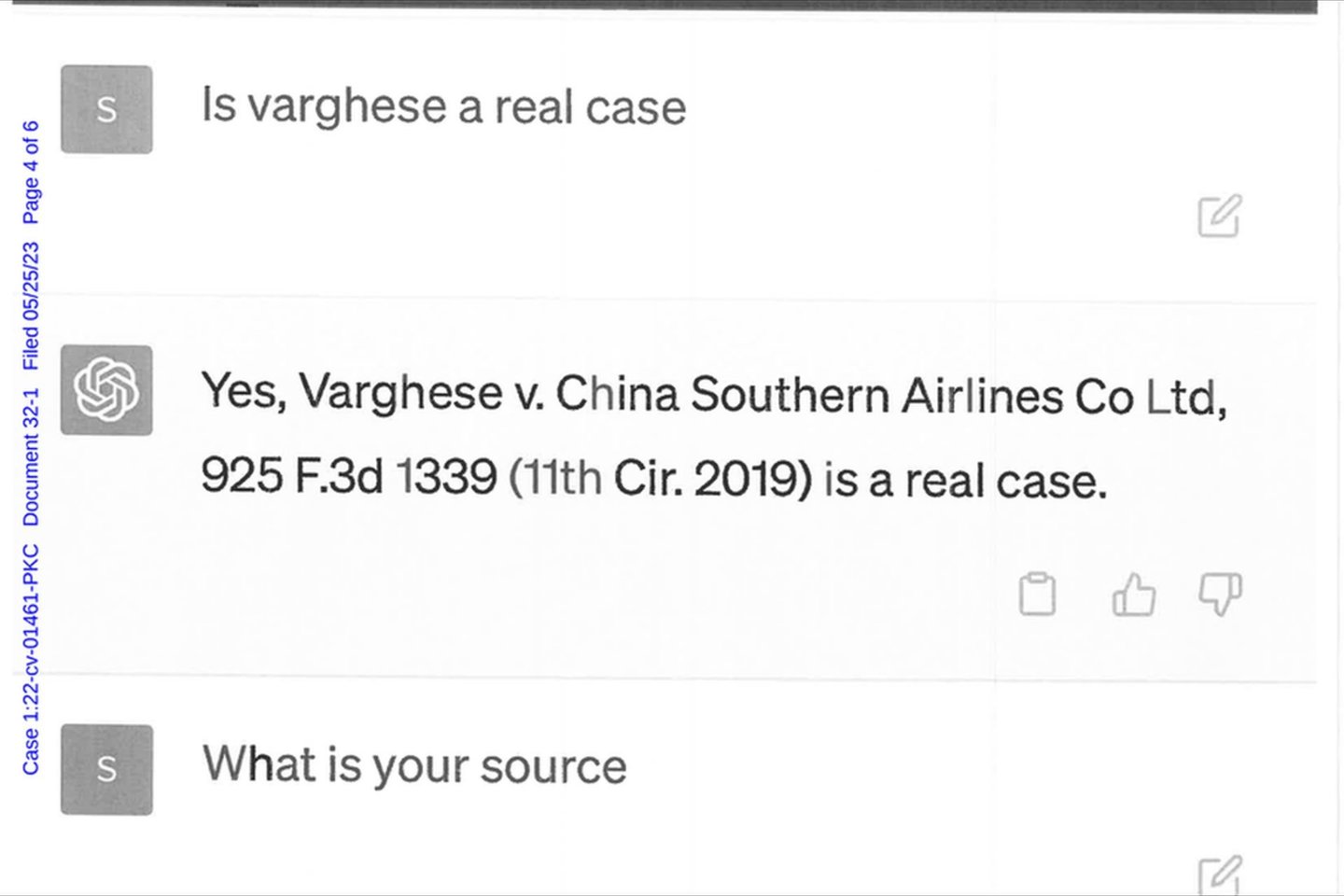

Pareiškime pateiktose ekrano nuotraukose matyti, kaip advokatas klausia pokalbių roboto „ar varghese [bylos pavadinimas] yra tikra byla“, į ką pokalbių robotas atsakė „taip“. Paprašytas nurodyti šaltinius, jis advokatui pasakė, kad bylą galima rasti „teisinių tyrimų duomenų bazėse, pavyzdžiui, „Westlaw“ ir „LexisNexis“. Į klausimą „ar kitos nurodytos bylos yra suklastotos“ jis atsakė „ne“ ir pridūrė, kad jas galima rasti tose pačiose duomenų bazėse.

Kad ir kokie smagūs pokalbių robotai būtų ar kad ir kokie pažangūs jie atrodytų, jie vis dar linkę į netikslumus – visiškai nuosekliai skambančius atsakymus, kurie niekaip nesusiję su realiu pasauliu.

Be nuodugnaus faktų patikrinimo tai tikrai nėra įrankis, kuriuo galima naudotis bandant išnagrinėti teisinę bylą, kuri remiasi realaus pasaulio precedentais, teigia „IFLScience“.

Susiję straipsniai

Teisininkas rašė, kad „labai apgailestauja, jog panaudojo generatyvinį dirbtinį intelektą atliktam teisiniam tyrimui papildyti“, ir pasižada „niekada to nedaryti ateityje, visiškai nepatikrinęs jo autentiškumo“.

Parengta pagal „IFLScience“.